2026年4月12日,MiniMax正式全球开源了其最新大模型——MiniMax M2.7。这不是一次普通的版本更新,而是AI领域第一次有模型真正实现了"自我深度迭代"能力。开源首日,华为昇腾、摩尔线程、沐曦、昆仑芯、NVIDIA等芯片厂商,以及Together AI、Fireworks、Ollama等推理平台迅速完成适配。这种响应速度本身就说明了一件事:行业太需要这个了。

MiniMax M2.7全球开源

MiniMax M2.7全球开源

为什么"自我迭代"这件事值得单独拿出来说

过去几年,大模型的训练模式本质上没有跳出"人类训练模型"的框架。研究员提出问题,设计实验,标注数据,再喂给模型学习。这个循环里最耗时间的不是模型"学"的过程,而是人类"喂"的过程——数据清洗、实验设计、结果分析,每一步都要人盯着。

M2.7想解决的就是这个瓶颈。

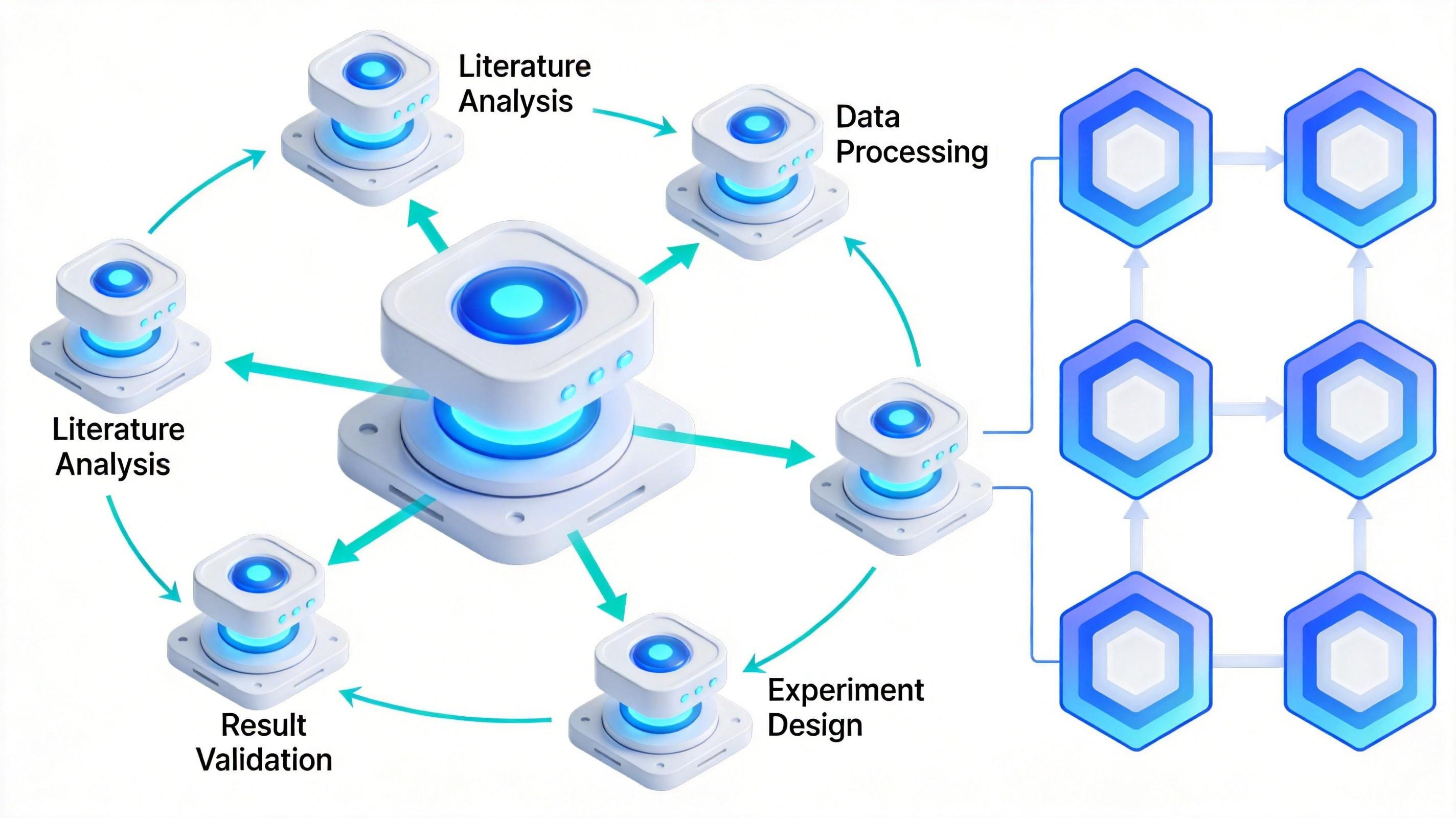

MiniMax团队在研发过程中,将M2早期版本引导为"研究型Agent Harness"。听起来复杂,做的事情其实很直接:让M2.7学会像研究员一样工作。它可以与不同研究项目组交互协作,在关键决策和讨论时才需要人类介入。这个模式下,模型不再是单纯的学习者,而是变成了研究工作的参与者。

效果怎么样?MiniMax给出的数据是:在部分RL场景下,M2.7能够胜任30-50%的工作流。这意味着过去需要研究员连续盯一周的实验,现在可能只需要介入几次关键节点。

几个关键能力指标

光说概念不够,先看硬数据。

软件工程领域,M2.7在多编程语言基准测试SWE-Pro中拿下56.22%的正确率。这个数字什么水平?GPT-5.3-Codex同样任务是56.20%。两家差了0.02个百分点,基本可以认为在同一档位。

不过更有参考价值的是另外两个测试集:

这两个测试更贴近真实场景——前者考验模型处理多语言代码的能力,后者要求同时处理多个软件工程的Bug定位任务。测试结果说明M2.7不是"考试型选手",而是能在实际工程里用起来的模型。

专业办公领域,M2.7在GDPval-AA得分达到开源模型最高水平。更夸张的是,在40个超过2000 Token的复杂Skills测试用例上,模型仍能保持97%的Skills遵循率。这个数字意味着,即使任务变得很长很复杂,模型依然能准确理解并执行指令,不会出现"说到一半忘了"的问题。

互动娱乐领域,M2.7构建了Agent交互系统OpenRoom。这套系统的核心思路是把AI互动放进Web GUI空间,让用户可以在浏览器里直接与AI角色对话、进行角色扮演等操作。随着模型Agent能力提升,这套系统还能持续进化。

华为昇腾的适配做了哪些优化

开源首日就能在国产硬件上跑起来,离不开华为昇腾的深度适配。昇腾团队针对M2.7做了几方面优化:

通信层优化:将AllReduce换成ReduceScatter和AllGather通信加速。这个改动听起来是底层调优,实际效果是减少了多卡通信时的等待时间,让数据流动更顺畅。

算子融合:深度优化了Transformer Attention前序全链路融合算子和MoE大融合算子。融合算子的意义在于减少计算过程中的中间张量读写和多算子调度开销——简单说就是让计算更连续,少做"读写转换"这种费时的操作。

负载均衡:在多DP并发场景下实现自适应DP域负载均衡,降低了prefill对decode的抢断。这个优化对重载场景特别有效——当很多人同时使用时,系统不会因为某个任务占用资源过多而导致其他人卡顿。

用户可以访问vllm官方文档获取适配指南,代码仓也已经开放。

MiniMax M2.7全球开源:首个自我深度迭代模型

MiniMax M2.7全球开源:首个自我深度迭代模型

开源这件事对行业意味着什么

M2.7的开源有几个值得关注的信号。

第一,大模型竞争进入"效率战"阶段。当各家基础能力差距逐渐缩小,谁能用更少的数据、更低的成本训练出更强的模型,谁就能在商业化上占优。M2.7展示的自我迭代能力,本质上是在解决"人工成本"这个最贵的变量。

第二,Agent能力成为新的分水岭。过去评价大模型主要看"理解"和"生成",现在行业开始关注模型能否自主规划、调用工具、协同工作。M2.7的Agent Harness设计就是往这个方向走的。

第三,国产硬件生态在快速跟进。昇腾、摩尔线程、沐曦、昆仑芯这些国产芯片厂商能在开源当天完成适配,说明国内AI硬件生态已经不是"裸奔"状态了。有了软件栈的支持,国产芯片在AI推理场景的可用性正在快速提升。

实际使用建议

如果你想上手M2.7,有几个路径:

直接体验:通过Together AI、Fireworks等云平台可以直接调用模型,适合快速验证能力。

本地部署:Ollama已经支持M2.7,可以在本地机器上跑完整模型。官方推荐配置是至少有32GB显存的显卡。

企业集成:如果要在生产环境使用,建议参考华为昇腾的适配指南。他们提供的vllm-ascend分支针对国产硬件做了专门优化,在推理效率和稳定性上更有保障。

这才刚开始

M2.7的开源只是MiniMax"自我进化"路线上的第一个里程碑。从官方透露的信息看,团队正在持续推进下一代模型的迭代。模型的自我进化能力会到什么程度?现在没有人能给出准确答案。但有一点是确定的:当模型开始参与自己的改进过程,这个循环的速度会远超纯人工迭代。

AI领域从来不缺"重大突破",但真正能让开发者用起来、让行业跟上去的不多。M2.7至少满足了后者的条件——开源第一天就能跑,benchmark有硬数据,芯片厂商已经适配完毕。剩下的就看社区用得怎么样了。

来源:

互联网

本文观点不代表区块经立场,不承担法律责任,文章及观点也不构成任何投资意见。

评论列表