从"盲测黑马"到"正式认领"

AI视频圈最近出了件有意思的事。

4月初,全球权威的Artificial Analysis视频竞技场突然冒出一匹匿名"黑马"——一个没有任何标识的模型在盲测中以1333 Elo分横扫榜单,把字节Seedance、可灵AI、昆仑万维SkyReels等一众明星选手甩在身后。

社区炸了锅。有人猜是某个大厂在憋大招,有人觉得是数据刷分,有人干脆称之为"来自神秘东方的力量"。

结果呢?4月10日,阿里巴巴ATH正式认领:这就是我们的HappyHorse-1.0。

说实话,这种"先匿名出道、再正式亮相"的玩法在AI圈已经不是第一次了。但这次不太一样——HappyHorse不是小打小闹的试水,而是实打实地刷新了行业纪录。

1333 Elo分意味着什么?

Elo分这东西,说白了就是让模型"真刀真枪"地PK。在Artificial Analysis的竞技场里,所有模型都要和其他对手进行大量对比测试,最后根据胜负关系算出排名。

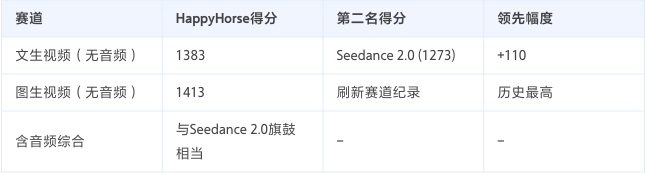

来看看HappyHorse交出的成绩单:

这个领先幅度用"断层式超越"来形容毫不为过。尤其是图生视频赛道,1413分直接把这个细分领域的上限往上拔了一大截。

有意思的是,这个模型还跑去和闭源商业产品同台竞技——对阵OVI 1.1胜率80%,对LTX 2.3胜率60.9%。开源模型能在盲测中打赢闭源竞品,这在视频生成领域还是头一回。

技术上,HappyHorse做对了什么?

150亿参数,40层统一自注意力Transformer架构,单卡H100生成5秒1080p视频只需38秒——这些纸面参数确实漂亮,但光看数字意义不大。

更值得关注的是几个技术细节:

原生支持音视频联合生成。大多数视频模型只能生成画面,音频要另外处理。HappyHorse从架构层面就把音视频绑定在一起,这意味着口型同步、多语言支持都能在一个模型里搞定。目前它原生支持英语、普通话、粤语、日语、韩语、德语、法语七种语言,唇形同步的词错误率在同类开源模型中最低。

性能足够接地气。38秒生成5秒视频看起来不算快,但别忘了这是单卡H100跑出来的成绩。对于中小企业和个人开发者来说,这个成本是可以接受的。相比之下,很多"性能更强"的模型实际上需要多卡集群才能运行,普通人根本用不起。

不过笔者也得泼点冷水:从目前社区反馈来看,HappyHorse在复杂时序动作建模上还存在明显短板,比如多人场景下的肢体关系偶尔会乱掉。这类问题在当前的视频生成模型中普遍存在,暂时没有哪家真正解决得好。

视频生成赛道的"诸神黄昏"

HappyHorse不是孤军奋战。看看最近几个月的市场动态,你就知道这个赛道有多卷了:

高盛的预测更是给这团火添了把柴:全球AI视频市场将从2025年的约30亿美元增长到2030年的约290亿美元,五年十倍的空间。

国产AI的"换位赛"

聊到这里,笔者想换个角度。

过去几年,提到AI视频,大家的第一反应往往是OpenAI的Sora、Runway的Gen系列、Pika Labs这些"洋面孔"。国产模型给人的印象更多是"追赶者"——技术上差半步、生态上弱一些。

但2026年的这波爆发正在改变这个叙事。

HappyHorse登顶至少说明一点:在视频生成这个赛道上,国产模型已经具备了和国际顶尖选手正面硬刚的实力。而且因为背靠中国市场,在中文场景、多语言支持、产业化落地上,国产模型反而可能更有优势。

当然,路还长。视频生成的"最后一公里"——物理世界的因果推理、长程动作的连贯性、细节纹理的真实性——这些问题哪家都没有彻底解决。但至少,牌桌上的玩家名单里,国产阵营已经占据了大半。

对普通创作者意味着什么?

说了这么多技术,普通读者最关心的可能是:这玩意儿能怎么用?

目前HappyHorse还在内测,正式API预计4月18日左右开放。但从MiniMax Music 2.6的玩法来看,未来的AI视频工具会越来越"傻瓜化":输入文字描述、选择风格、一键生成,实际门槛会降到普通创作者都能上手的程度。

对于内容创作者来说,这是好事。视频制作的效率会大幅提升,以前需要一个团队才能完成的短视频,未来可能一个人加一个AI工具就能搞定。

对于AI导航网站的用户而言,重点是保持关注、提前上手。这个领域变化太快,今天的领先者可能三个月后就被反超,持续学习和尝试才是王道。

总结

阿里HappyHorse-1.0登顶全球视频生成竞技场,不只是一个排名数字的变化。它背后反映的是国产AI在多模态视频生成领域从技术突破到生态构建的全面提速。

视频生成赛道正在进入"战国时代",但对普通用户和开发者来说,这意味着更多的选择、更低的成本、更快的迭代。唯一不变的是:跟上节奏,持续学习。

来源:

互联网

本文观点不代表区块经立场,不承担法律责任,文章及观点也不构成任何投资意见。

评论列表