引言

过去几年,大模型的竞争集中在云端参数规模与训练能力;而2026年,行业共识已经转向更贴近用户、更安全、更实时的端侧AI。

端侧AI,是指将大模型直接部署在手机、穿戴设备、汽车、工控设备、本地服务器等终端设备上,实现数据本地处理、离线可用、低延迟响应与隐私不出域。它不再是云端AI的补充,而是与云端并行的新一代AI基础设施。

对于普通用户,端侧AI意味着更流畅的体验;对于企业,意味着更低算力成本与更高数据安全;对于开发者,则意味着全新的产品形态与商业模式。本文从技术、硬件、场景、选型四个维度,完整呈现端侧AI大模型的全貌与实战落地方法。

一、端侧AI爆发的核心原因:从“不能用”到“好用”

1. 隐私安全刚需

政务、金融、医疗、企业内部资料等敏感数据无法上传云端,端侧本地推理从根源避免数据泄露,满足合规要求。

2. 实时性体验提升

云端AI存在网络延迟,而端侧AI可实现毫秒级响应,尤其适合语音交互、实时翻译、AR/VR、车载控制等场景。

3. 算力成本大幅下降

长期云端调用费用高昂,端侧一次部署即可重复使用,显著降低企业与平台的算力开销。

4. 离线可用成为标配

无网络、弱网环境(户外、偏远地区、机舱、地下空间)下仍可稳定使用,扩展AI适用边界。

多重因素叠加,使端侧AI在2026年从概念走向规模化商用,成为AI行业最重要的技术主线之一。

二、端侧AI大模型核心技术突破

端侧能运行大模型,并非简单“缩小模型”,而是一整套底层技术体系的成熟。

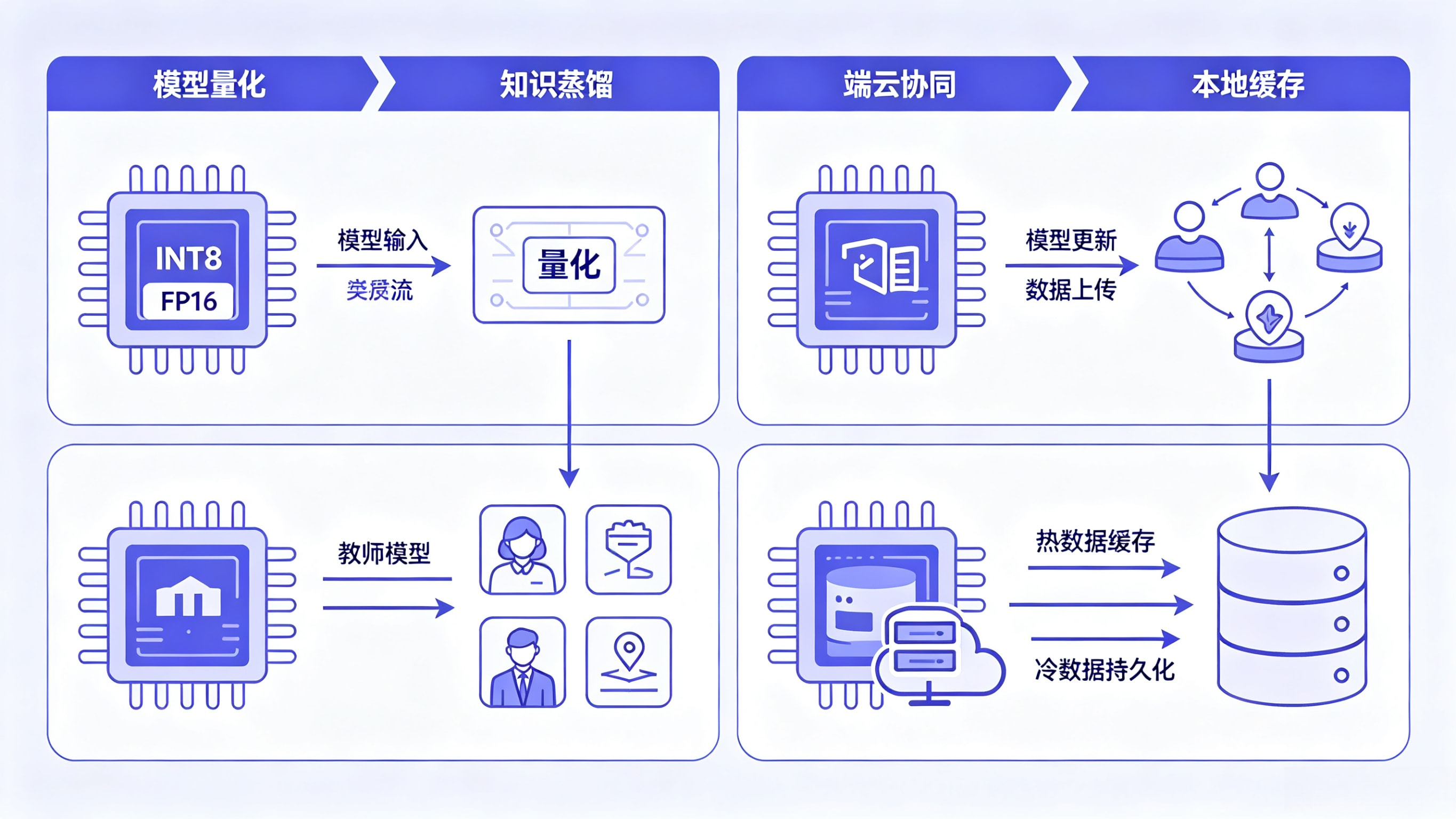

1. 模型量化与压缩技术

通过低位宽量化(4bit、2bit甚至更低精度),在几乎不损失效果的前提下,将模型体积缩小至原来的1/10~1/20,大幅降低内存占用与算力需求。同时结合结构化剪枝、动态稀疏计算,实现高吞吐、低功耗推理。

2. 知识蒸馏与小模型增效

用大模型作为“教师模型”,训练轻量化“学生模型”,让小模型继承大模型的能力,实现体积小、速度快、效果接近大模型,适合端侧长期稳定运行。

3. 端云协同推理架构

简单任务本地处理,复杂任务上云,形成终端感知+本地轻推理+云端强推理的混合架构。既保证速度,又不损失能力,是当前最主流的商用方案。

4. 缓存机制与长期记忆本地化

将用户习惯、历史上下文、常用知识库存在本地,减少重复计算,提升响应速度,同时保护用户隐私数据。

5. 硬件加速与驱动优化

专用NPU、ISP、AI加速器与模型深度耦合,实现功耗与性能的最优平衡,使端侧AI可在移动设备上长时间运行而不发热、不掉帧。

三、支撑端侧AI的硬件生态

2026年,端侧AI硬件已形成完整梯队,覆盖从消费级到企业级全场景:

移动端/穿戴设备:手机、AI眼镜、耳机内置独立AI芯片,支持离线语音、实时翻译、图像理解、会议纪要。

车载设备:车机端AI大模型实现车内智能交互、驾驶辅助、场景化推荐,数据不出车,保障安全隐私。

PC/笔记本:本地AI助手实现文档总结、代码编写、图片处理、系统优化,不依赖网络。

企业端侧盒子:轻量化本地推理主机,适合中小企业私有化部署,成本远低于传统私有云。

工业/物联网终端:工控机、摄像头、机器人搭载端侧AI,实现实时质检、异常检测、自主决策。

硬件普及进一步降低端侧AI落地门槛,使“人人可用、设备皆AI”成为现实。

四、端侧AI典型落地场景(2026主流应用)

1. AI眼镜与随身智能

端侧AI让眼镜具备离线同声传译、实景识别、实时字幕、导航提示等能力,无需联网也能稳定工作,成为商务人士、出境出行、特殊需求人群的标配设备。

2. 企业本地办公与隐私场景

财务数据、合同文本、内部会议记录在本地处理,不上传云端,杜绝泄密风险。端侧AI可自动生成纪要、整理文档、审核表格,兼顾效率与安全。

3. 车载智能座舱

车内语音交互、路线规划、空调座椅调节、驾驶行为分析全部本地运行,响应更快,同时避免位置、音频等隐私数据上传。

4. 工业与安防边缘计算

摄像头与工控设备本地实时分析画面,识别安全隐患、设备故障、生产异常,延迟更低、可靠性更高,适合无人车间、园区安防、电力巡检。

5. 家庭与服务机器人

端侧AI让机器人具备本地理解能力,可自主规划路线、识别物品、响应指令,断网也能正常工作,提升智能家居体验。

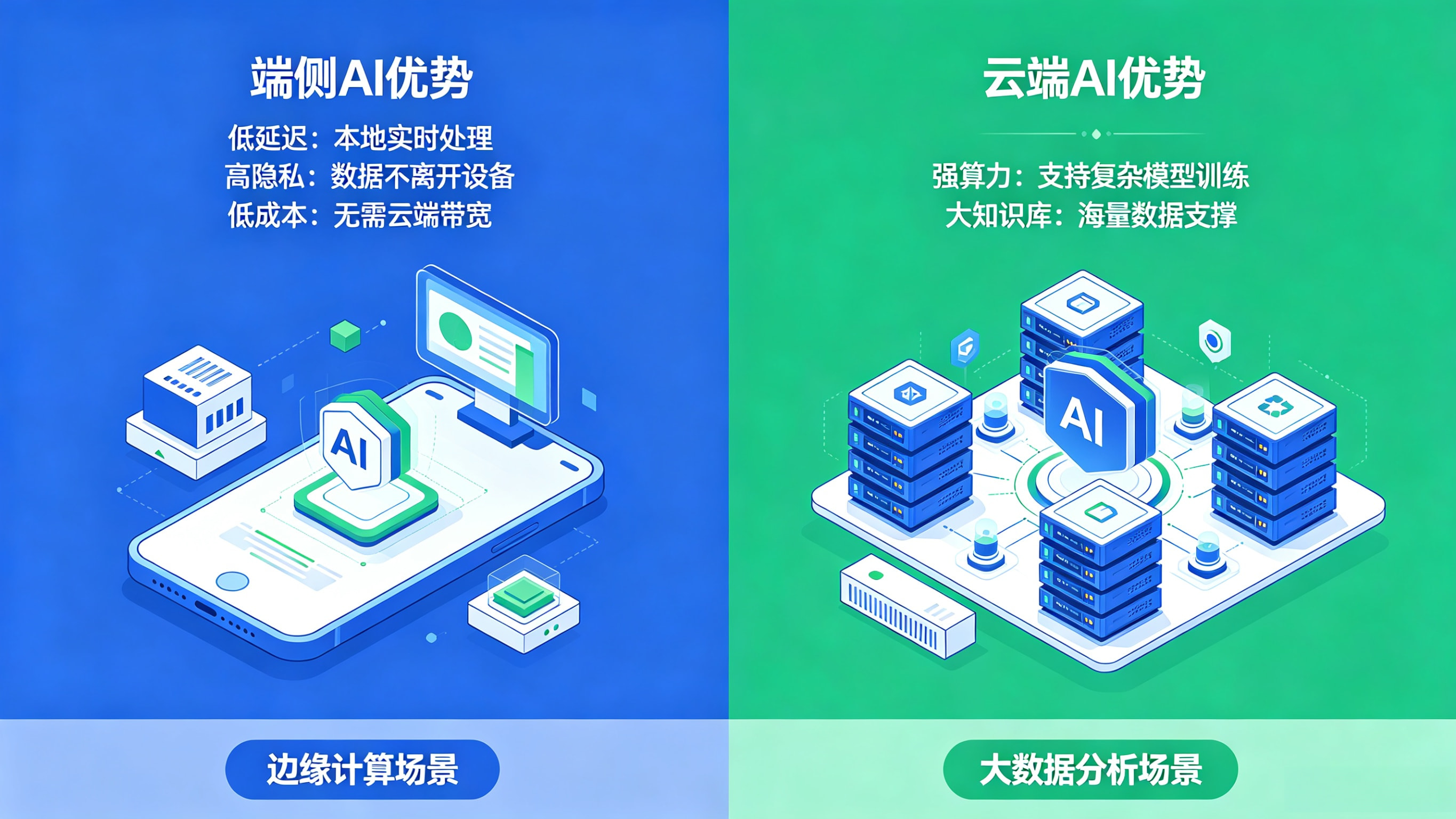

五、端侧AI vs 云端AI:如何选型?

适合端侧AI的场景

敏感数据、企业内部资料

实时交互、低延迟要求高

弱网/离线环境

长期高频使用、控制成本

隐私合规严格行业(金融、政务、医疗)

适合云端AI的场景

超大规模复杂推理、多模态深度创作

需要实时联网更新海量知识库

短期使用、不适合本地部署

算力需求极高、无法在终端承载

实际商用中,绝大多数产品采用端云一体混合架构,兼顾体验、安全与成本。

六、端侧AI未来趋势(2026—2027)

模型更小更强:2bit量化、动态结构稀疏进一步普及,小模型逼近大模型效果。

端侧多模态普及:本地同时支持文本、语音、图像、视频理解,不再依赖云端。

硬件进一步专用化:AI加速器成为终端标配,功耗更低、性能更强。

垂直行业端侧模型爆发:法律、医疗、制造、教育出现专用轻量化端侧大模型。

安全机制内置化:端侧AI自带隐私保护、数据加密、权限管控,合规成为基础能力。

七、挑战与未来瓶颈

尽管发展迅速,端侧AI仍面临挑战:

极端轻量化后能力损失,需要持续优化算法

不同硬件适配成本高,生态碎片化

端云协同调度策略复杂,对工程能力要求高

行业标准尚未完全统一,部署成本仍有下降空间

但整体来看,技术迭代速度极快,上述问题将在未来1–2年内快速缓解。

结尾

2026年,是端侧AI真正走向普及的元年。

从云端大一统,到端云协同分工,再到终端自主智能,AI正在从“中心化服务”走向“无处不在的分布式能力”。对于企业而言,提前布局端侧AI,意味着更低成本、更高安全、更好体验;对于开发者,端侧大模型是下一代产品创新的核心入口;对于普通用户,端侧AI将彻底改变日常工作、出行、生活与交互方式。

把握端侧AI,就是把握AI行业下一个十年的核心方向。

来源:

互联网

本文观点不代表区块经立场,不承担法律责任,文章及观点也不构成任何投资意见。

评论列表