4月12日深夜,MiniMax发布了一个叫M2.7的开源模型。参数规模2300亿,稀疏MoE架构,在编程和终端操作任务上拿到了56%和57%的分数——这些数字放在当前开源模型里确实不错,但算不上石破天惊。

真正让圈内人倒吸一口凉气的,是这个模型身上出现的一个前所未有的能力:它可以改写自己的训练代码,从而参与自身的训练循环,并在这个过程中实现约30%的性能自我优化。

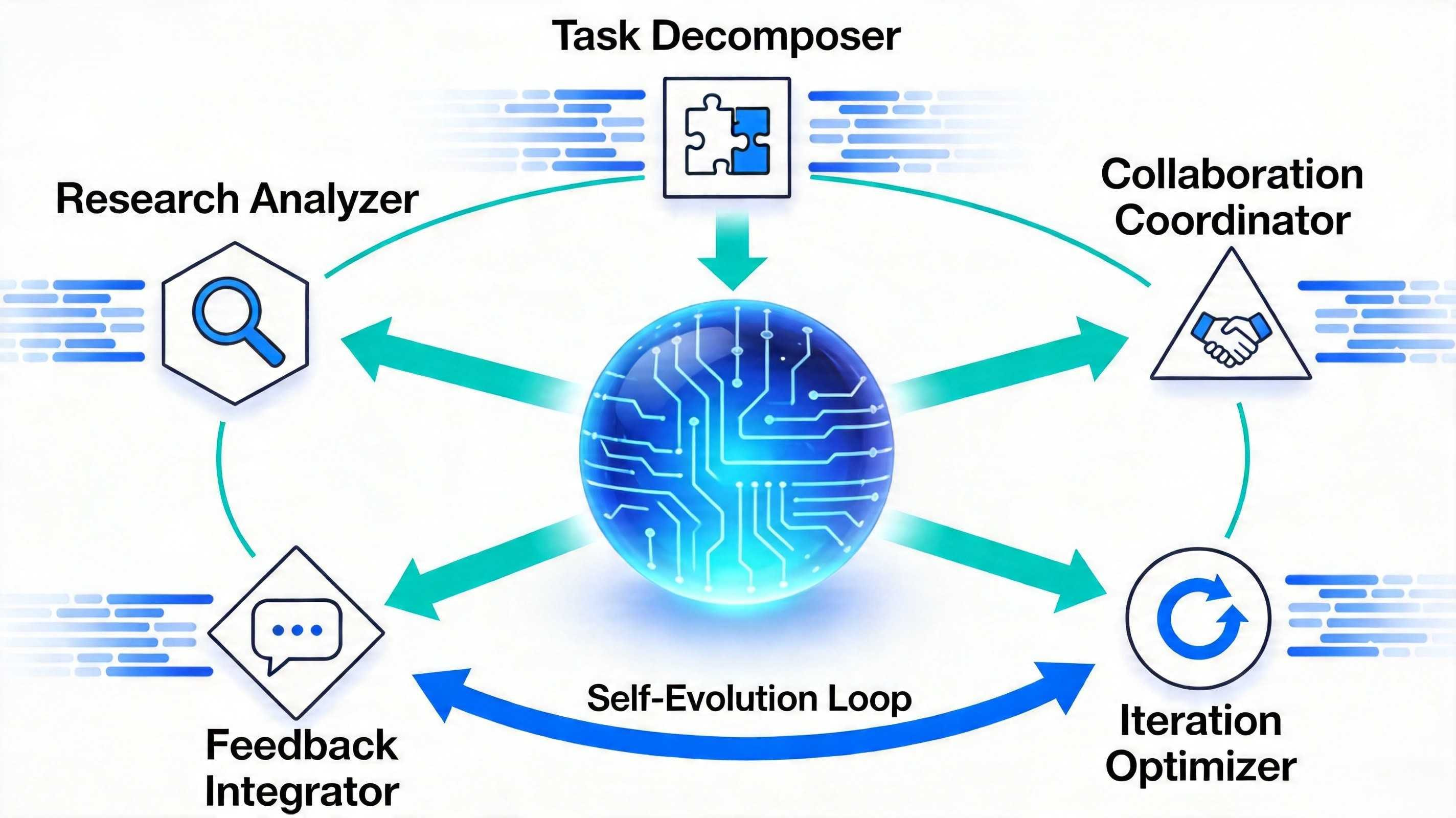

MiniMax M2.7自进化训练技术概念图

MiniMax M2.7自进化训练技术概念图

这事听起来有点绕,但细想下去其实挺吓人。

以前的模型是怎么"出生"的?

理解M2.7的特殊性,得先搞清楚传统大模型的训练流程。

简单说,传统模型的训练是个"一次性"过程:人类工程师写训练代码,准备数据集,跑训练,输出模型,结束。如果模型表现不及预期,解决办法是调参、改数据、换架构——但无论怎样,模型本身没有能力介入自己的"出生"过程。

打个比方,就像你做饭:菜谱是别人写的,食材是别人准备的,你只能按照既定流程做出来。做得好不好,取决于菜谱写得怎么样、食材质量怎么样。你自己没法修改菜谱。

M2.7打破了这个设定。

M2.7是怎么做到的?

根据MiniMax在arXiv公开的论文,他们把这个机制称为"自进化训练"(Self-Evolution Training)。

具体实现大概是这样:模型权重中包含了对自身训练流程的"元认知"能力。当收到特定指令后,M2.7能够分析自身的代码结构,识别可优化的训练子程序,并通过一个受控的自我修改机制,对训练循环中的特定模块进行重新编写和迭代。

这不是简单的"让模型生成更好的提示词来引导自己"。M2.7改的是底层的训练代码本身——是模型在参与自身被创造的过程。

按照MiniMax技术报告的说法,经过三轮自进化迭代后,模型在编程相关任务上的表现平均提升了30%,在推理任务上的提升约为18%。而且这个优化过程没有额外的人工干预。

MiniMax M2.7自进化训练工作流程图

MiniMax M2.7自进化训练工作流程图

稀疏MoE架构:省钱的底层逻辑

M2.7采用的是稀疏MoE(混合专家)架构,这是近年来大模型设计中的一个重要技术路线。

传统大模型在处理任何输入时,都会激活全部参数。这在工程上效率低下,因为许多参数在不同任务中其实并不需要同时被调用。

稀疏MoE的思路是:将模型拆分成多个"专家"子网络,每次推理时只激活最相关的少数专家网络。

2300亿参数听起来很大,但如果采用稀疏激活的方式,每次推理可能只激活其中约15%-20%的参数。这意味着M2.7的实际推理成本,接近一个300-400亿参数级别的密集模型,但能力边界却接近甚至超越了许多参数规模更大的密集模型。

MiniMax选这个架构,有明确的商业考量:更低的推理成本,意味着在构建AI应用和Agent产品时,运营成本更低,商业可行性更高。

开源背后的市场逻辑

M2.7选择全面开源,代码和权重均在Hugging Face平台公开。

这个决定背后,是MiniMax清晰的市场判断:AI编程工具和AI Agent是当前最具商业价值的应用方向,而这两个方向的竞争,本质上是开发者生态的竞争。谁能让更多开发者围绕自己的模型构建工具和应用,谁就能建立护城河。

开源是赢得开发者最有效的方式。没有了API调用的成本门槛,全球开发者可以自由地微调、部署和构建应用。

更关键的是,M2.7得到了英伟达和华为昇腾两大硬件平台的支持。对于中国开发者来说,能够在华为昇腾芯片上本地部署M2.7,意味着国内企业可以在不完全依赖英伟达GPU的情况下,用上当前最强的开源编程Agent模型之一。

意味着什么?

M2.7的出现,至少说明了几个问题:

开源社区在AI编程和自主行动这两个高价值能力维度上,正式向闭源头部玩家发起了挑战。 在SWE-Pro和Terminal Bench上的表现,让开源中国模型第一次站上了与闭源顶级模型正面竞争的擂台。

"模型自我迭代"的范式可能正在成熟。 如果一个模型能够持续自我优化而不需要人类工程师重新训练,它的迭代速度将远超依赖外部反馈的传统训练模式。

当然,现在说这代表着大模型训练范式的根本转变还为时过早。M2.7的自进化机制目前主要应用在编程和推理任务上,泛化能力还需要更多验证。

但有一点是确定的:MiniMax迈出了这一步。

接下来的问题是:下一个会是谁?

来源:

互联网

本文观点不代表区块经立场,不承担法律责任,文章及观点也不构成任何投资意见。

评论列表